Faltan 35 años para que los aviones no tripulados desarrollados actualmente por EE. UU. funcionen sin control humano alguno y se conviertan en verdaderos ‘robots asesinos’. Medio Oriente sufrirá primeramente sus consecuencias.

La principal arma de la CIA y las Fuerzas Armadas de EE. UU. para combatir a los grupos extremistas de la conflictiva región son los drones no tripulados. Hace una década, el número de estos aparatos no rebasaba unas cuantas unidades, pero ahora existen más de 7.500 y su producción se acelera cada día más. El 26 de enero pasado, el Pentágono anunció que comprará 100.000 piezas más. La razón: son más baratos tanto en su construcción como en su operación que los aviones tripulados.

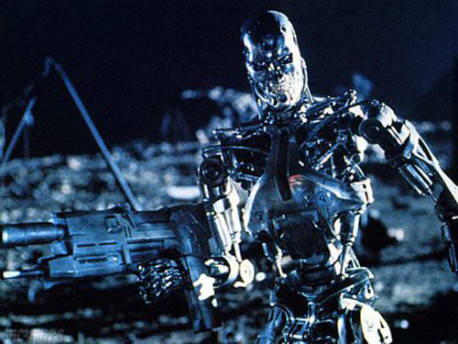

Pero para los militares estadounidenses el potencial de estos aparatos no ha sido totalmente aprovechado. El plan antiterrorista de EE. UU. tiene como objetivo conseguir que para el año 2047 los drones no tripulados puedan operar sin ninguna supervisión humana, ni siquiera desde centros de control remotos como se hace ahora. Estos artefactos podrían funcionar independientemente gracias a un nuevo software y a sofisticadas computadoras.

“Los avances en inteligencia artificial harán posible que estos sistemas tomen decisiones de combate y actúen sin necesitar la intervención humana”, sostiene el documento titulado ‘Unmanned Aircraft Systems Flight Plan 2009-2047’. Según este texto, actuarán conforme a lo programado, mientras que los humanos podrán vetar sus decisiones y reprogramarlos, eso si logran hacerlo suficientemente rápido.

«El mayor atractivo de los sistemas no tripulados es no mandar a nuestros hijos e hijas al peligro”, comenta por su parte Peter W. Singer, experto en Medio Oriente de la Institución Brookings (EE. UU.) en un artículo publicado en The New York Times. Sin embargo, advierte: “Cuando los políticos puedan evitar las consecuencias de una carta de condolencias y el impacto que las bajas militares tienen sobre los electores y medios de comunicación, ya no considerarán las cuestiones de guerra y paz, anteriormente de peso, de la misma manera”.

A Noel Sharkey, informático británico y experto en robots, le interesa otro aspecto del problema. “Las acciones letales deben tener una cadena clara de responsabilidades. Con las armas robóticas es muy difícil. Un robot no puede ser considerado responsable. Entonces, ¿quién será? ¿El comandante que lo usó? ¿El político que lo autorizó? ¿El proceso de adquisición militar? ¿El fabricante?”, acentúa.

Hoy en día, los drones manejados desde centros de control remotos son una parte esencial de las operaciones de EE. UU. en Asia. Ejercen vigilancia en los territorios de Afganistán, Yemen, Pakistán e incluso Irán. Se informa que tuvieron un papel clave en el operativo que acabó con el terrorista número uno del mundo, Osama bin Laden, igual que en otras operaciones contra los miembros de Al Qaeda.

Sin embargo, según la organización de defensa de los derechos humanos Human Rights Watch, las víctimas de sus ataques son principalmente los civiles. Solo en Pakistán, durante los últimos ocho años los ‘fallos’ por parte de aviones estadounidenses no tripulados dejaron un saldo de entre 2.292 y 2.864 víctimas mortales entre la población civil, entre ellas había al menos 168 niños, según calcula la Oficina de Periodismo de Investigación (Londres).