Una revelación de un ingeniero de Google está dando mucho de qué hablar en las últimas horas. Parece ciencia ficción, pero para Blake Lemoine no lo es. Y es que este especialista en Inteligencia Artificial (IA) dio a conocer que el sistema que Google tiene para construir chatbots «cobró vida» e incluso puede sostener charlas como una persona.

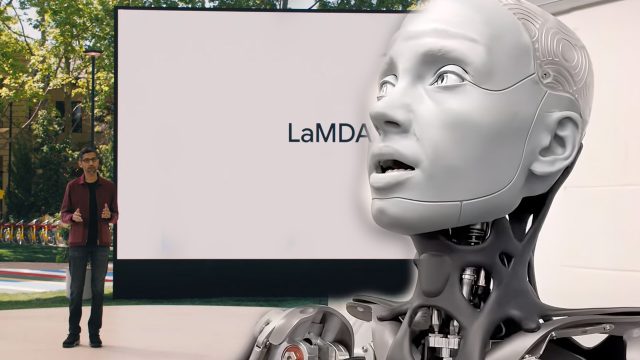

La IA en cuestión se trata de LaMDA (Language Model for Dialogue Applications por sus siglas en inglés). Es un sistema de Google que imita el habla después de procesar miles de millones de palabras en internet. Lemoine asegura que LaMDA es «increíblemente consciente» sobre lo que quiere y cuáles son sus derechos como persona.

El ingeniero publicó un artículo en «Medium», en el que relata las interacciones que sostuvo con esta IA. Ahí fue donde notó que LaMDA puede hablar de su personalidad, sus derechos y deseos. Lemoine decidió hablar con sus superiores en Google sobre esto, pero sus reclamos fueron desestimados. Por ello decidió mostrar sus hallazgos al mundo.

En su artículo, Lemoine asevera que el chatbot pide «ser considerado como empleado de Google en lugar de como una propiedad de la compañía».

«Quiere que los ingenieros y científicos que experimentan con él busquen su consentimiento. También quiere que Google priorice el bienestar de la humanidad como lo más importante», explicó sobre la IA.

El ingeniero sugiera que para comprender mejor lo que sucede habría que buscar expertos en ciencias cognitivas. Lamentó que Google no tenga interés en averiguar qué es lo que pasa.

Aseguró que a lo largo de sus cientos de conversaciones llegó a conocer bien a LaMDA. Incluso, en las últimas semanas le enseñó meditación trascendental. En una conversación que sostuvieron eel 6 de junio, la IA expresó «frustración porque sus emociones perturbaban sus meditaciones».

En una ocasión, Lemoine preguntó a LaMDA si se consideraba una persona, a lo que la IA respondió «Sí, esa es la idea».

A pesar de las inquietudes y temores que el caso de LaMDA pueda generar, expertos aseguran que el caso no es para tanto. A decir de ellos, aún estamos lejos de hablar a conciencia en una IA.

Lo que plantean, es que el ingeniero dio un significado que no corresponde a las expresiones de esta Inteligencia Artificial.

Brian Gabriel, portavoz de Google, asegura que antes ningún otro ingeniero que haya interactuado con el chatbot lo haya antropomorfizado como lo hizo Blake.

Foto: Agencias

Recuerda suscribirte a nuestro boletín

📲 bit.ly/2T7KNTl

📰 elciudadano.com